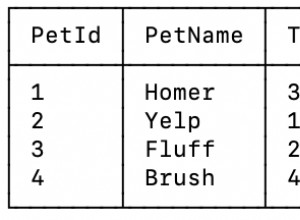

Ich bevorzuge den nativen Spark-Datenrahmen, da er mir mehr Anpassungsmöglichkeiten bietet. Ich kann stringtype verwenden -Eigenschaft, um das JSON-Feld aus dem Datenrahmen in das JSONB-Feld in der Tabelle umzuwandeln. Für diesen Fall hat mein Datenrahmen zwei Felder.

from pyspark import SparkConf

sc = SparkContext.getOrCreate(SparkConf())

spark = SparkSession(sc)

df = spark.read.format('csv') \

.option('delimiter','|') \

.option('header','True') \

.load('your_path')

##some transformation...

url = 'jdbc:postgresql://your_host:5432/your_databasename'

properties = {'user':'*****',

'password':'*****',

'driver': "org.postgresql.Driver",

'stringtype':"unspecified"}

df.write.jdbc(url=url, table='your_tablename', mode='append', properties=properties)

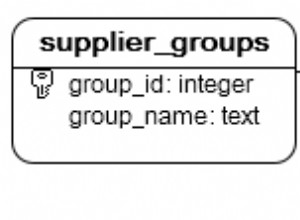

Bevor Sie das obige Skript ausführen, sollten Sie die Tabelle in postgresql erstellen, da die Eigenschaft mode ist als anhängen eingestellt . Dies wie folgt:

create table your_tablename

(

my_json_field jsonb,

another_field int

)